Pascal : Architecture for Artificial intelligence

پاسکال : معماری برای هوش مصنوعی

خوب باید همین اول بگم از نتایج و قابلیت های NVIDIA Drive PX.2 که تنها اثر و نمود حضور پاسکال در CES.2016 بود بشدت شوکه شدم . تنها منبع فعلی ما برای برآورد معماری همین drive px.2 هست .

با دیدن معماری و مکانیزم عملگرد px.2 با 2 تراشه گرافیکی پاسکال به راحتی میشه متوجه شد پاسکال طوری طراحی شده تا بتونه شبکه های عصبی مغز را شبیه سازی کند .

برای اینکه معماری خودمختار باشد و شبیه مغز انسان باشد باید Front end خیلی قوی ای داشته باشد . اگر FE خیلی قوی داشته باشد شبیه CPU میشود . موردی که در معماری فرمی شاهد اون بودیم .

به تصویر زیر دقت کنید : با یه تقریبی از تعداد هسته ها به نسبت سطح تراشه میشود به راحتی حجم FE نسبت به Core count رو تقریب زد . ( در این تقریب معماری Fermi قوی ترین Front end ونزدیک به cpu و کمترین قدرت خام محاسباتی و VLIW بیشترین تعداد هسته به نسبت تعداد ترانزیستوری هایی که برای طراحی تراشه به کار رفته و بیشترین قدرت محاسباتی خام )

الف ) در شکل بالا هرچقدر معماری ها به سمت چپ نزدیک باشند به معماری cpu نزدیکتر و خودمختاری تراشه بالاتر اما تعداد هسته ها کمتر و قدرت خام کمتر .

ب ) اما هرچقدر معماری ها به سمت راست نزدیکتر باشند تعداد هسته ها بیشتر و قدرت محاسباتی خام بالاتر اما توان محاسباتی و خود مختاری تراشه کمتر.

خوب این به چه معنا در پاسکال است ؟ به این معنا که در نسل پاسکال تعداد هسته ها افزایش پیدا نمیکنند ( تغییرات ناچیز) اما تعداد ترانزیستور هایی که برای Front end کلاستر ها به کار رفته است بسیار افزایش پیدا میکند . اما چگونه میتوان قهمید معماری پاسکال به سمت هسته های کمتر حرکت کرده ؟؟

من با ضریب اطمینان بالایی خدمت دوستان عرض میکنم تعداد هسته ها در پاسکال به طور مثال در GP104 تفاوت زیادی با GM204 نخواهد کرد . اما تعداد ترانزیستور های به کار رفته برای GP104 ( اگر این اسم تراشه باشد) حدودا 2 برابر GM204 خواهد بود .

چایگاه Polaris هم جالب هست که بالانسی بین FE و Core count و این نشون دهنده راه amd هست . البته نکته جالب توجه ازفیش حرکت اون به سمت پردازنده ای شدن معماری هست ( یعنی قدرت بالاتر FE )

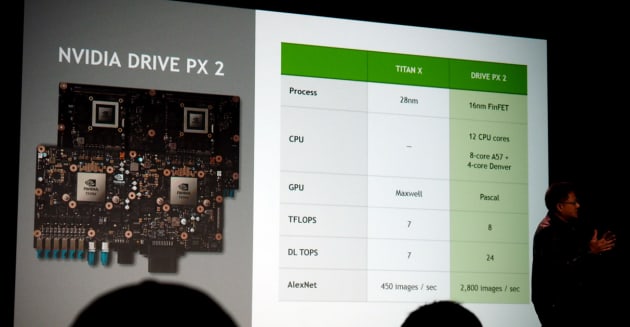

به مقایسه پاسکال با GTX TITAN X دقت کنید :

مصرف کلی PX.2 با TITAN X برابر است . هر 2 250 وات مصرف میکنند . با فرض حذف 2 تگرا که اونها هم از GPU PASCAL استفاده میکنن و کل سیستم رو از یک تراشه PASCAL در نظر بگیریم داریم :

1 ) قدرت محاسباتی هر 2 بسیار به هم نزدیک است و حدود 8-7 ترا فلاپس است .

این یعنی تعداد هسته ها در پاسکال 2 برابر نمیشود و تغییر نخواهد کرد . ( اما تعداد ترانزیستور های به کار رفته 2 برابر شده است )

2) DL TOPS به مخفف DEEP learning Tera operation per second بیش از 3 برابر شده .

البته انویدیا در متن خود ادعا کرده در الگوریتم های پیچیده اختلاف حدود 10 برابر است .

3) Alexnet ب ااستفاده شبکه نرون های مغز با استفاده از شبکه کانوولوشن ( کانوولشن انتگرال پیچیده برای توابع است که اونایی که انتگرال های کانوولشن برای تجیزیه و تحلیل سیگنال ها دیدن میفهن من چی میگم ) که تصاویر رو درک و محاسبه می کند .

این به این معناست که در عمل کارایی سیستم 6.2 برابر معماری نسل قبل ماکسول است که عدد خوبی برای شبکه هوش مصنوعی است .

اما در بخش Gaming :

ار یو ف ا.کینگ کدینگ می ؟؟ دیپ لرنینگ و هوش مصنوعی به درد ما انصافا نمیخوره و از حوزه ما خارجه . ببنیم این معماری در گیمینگ چه میکنه ؟

در حال حاظر جز یک دورنمای خیلی دور چیزی از معماری پاسکال نداریم . اما چیزی که واضح هست اینه که معماری به شدت به سمت معماری fermi در حرکت است و قدرت FE تراشه نسبت به نسل قبل خیلی بیشتر میشود .

چیزی که من پیشبینی میکنم بازگشت کامل HW Scheduler ها و یک سیستم fe بسیار پیچیده با هسته های کم هست ( چیزی شبیه به فرمی سابق )

38Likes

38Likes LinkBack URL

LinkBack URL About LinkBacks

About LinkBacks

پاسخ با نقل قول

پاسخ با نقل قول

.jpg)

)

)